J’apprends avec tristesse la mort d’un grand linguiste-mathématicien : Aravind Joshi, que j’ai assez bien connu et souvent rencontré dans diverses conférences et écoles d’été. Il m’avait même invité à passer quinze jours dans son laboratoire de Philadelphie en 1998. Il était drôle, jovial, d’un esprit remarquablement ouvert. D’origine indienne, il regardait son pays avec compassion et un peu de dérision. Comme je lui disais à l’époque que j’étais passionné par l’Inde, il m’avait répondu : « ça vous passera ». De fait, avec l’arrivée au pouvoir de Nahendra Modi, ça m’a un peu passé… Lui venait de Puna, dans le Maharashtra, pas loin de Mumbai, mais il vivait en Amérique depuis bien longtemps. Le crâne complètement chauve, rond comme un oeuf d’autruche, et le regard malicieux, on ne lui donnait pas d’âge. Il semblait éternel. Voici qu’il a rejoint Ganesha et d’autres Dieux de l’hindouisme (auquel il ne croyait pas, bien entendu).

Pour mes lecteurs non informés des théories existantes dans le champ de l’analyse automatique des langues naturelles, je dirai que son apport principal est l’invention des « Grammaires d’Arbres Adjoints » – Tree Adjoining Grammars, en V.O. ce qui donne l’acronyme TAG (il avait beaucoup ri, à Grenoble, de voir écrit le nom de son formalisme au flan de tous les bus et trams de l’agglomération – Transports de l’Agglomération Grenobloise).

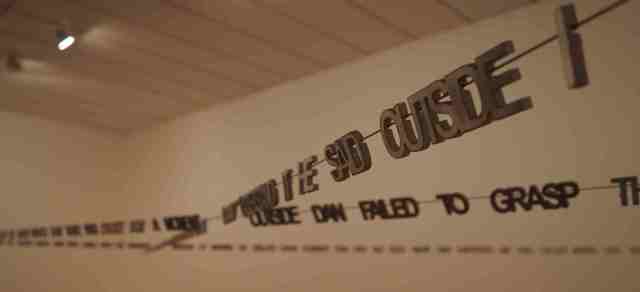

Lorsqu’on étudie les langues, qu’elles soient formelles ou naturelles, on remarque toujours qu’elles présentent des régularités étonnantes. La liste de ces régularités fonde le fait que l’on puisse rapprocher les deux sortes de langue. Par exemple, il n’échappe à personne que les phénomènes d’accord se font à distance. Je dis et j’écris : « le chat ronronne » et « les chats ronronnent », mais aussi : « le chat que la jeune femme caresse ronronne » et si je change « le » en « les » aussitôt, « ronronne » devient « ronronnent », de même si je change « la jeune femme « en « les jeunes femmes », « caresse » deviendra « caressent ». Autrement dit des liens à distance fini existent à l’intérieur des phrases d’une langue dite « naturelle ». On peut étudier mathématiquement ces phénomènes en proposant des modèles de grammaire très rudimentaires, qui ont leur rôle dans la fabrication des langages informatiques, par exemple le langage des mots de la forme « suites de a et de b avec le même nombre de a et de b » est aussi un langage présentant ce genre de régularité : si j’ajoute un « a » je devrai nécessairement ajouter un « b » pour demeurer à l’intérieur du même langage (du même ensemble). Si les « a » sont à la suite et les « b » aussi, comme dans « aaabbb », on a un langage facile à analyser : Noam Chomsky au temps de sa jeunesse avait introduit la notion de « grammaire hors-contexte » pour prendre en compte ces langages. Encore faut-il que les dépendances soient enchâssées (comme dans notre exemple du chat et de la voisine). Si on veut qu’elles soient croisées comme c’est le cas dans des langues comme le néerlandais ou le suisse allemand, cela devient une autre paire de manches : on ne peut tout simplement pas les décrire au moyen des grammaires hors-contexte, on tombe dans des langages un peu plus complexes, qu’on appelle les « langages doucement contextuels » (mildly context-sensitive). C’est Joshi qui a mis l’emphase là-dessus et est passé à un type de grammaire analysant ces langages doucement contextuels. Il avait vu que si, au lieu d’adjoindre des arbres syntaxiques les uns aux autres en partant de la racine et en substituant banalement un arbre à une feuille en allant jusqu’au bout pour trouver la phrase, on autorisait l’agencement de mini-arbres syntaxiques selon des schémas plus complexes – par exemple en insérant un arbre de racine A ayant une feuille également de type A à l’endroit d’un A dans l’arbre primaire – on pouvait obtenir la puissance d’analyse demandée. De plus, il était possible d’évaluer la complexité des objets obtenus (toujours une complexité polynômiale, ce qui veut dire que ce n’était pas « trop » compliqué).

Aravind Joshi a eu beaucoup d’influence en France, notamment auprès de certain(e)s linguistes de Paris 7, comme Anne Abeillé et Danièle Godard, qui ont dirigé un projet de réalisation de la grammaire du Français grâce aux TAGs (la « Grande grammaire du Français »). J’avais rencontré Joshi parce qu’il était intéressé par le travail que nous faisions dans les années quatre-vingt-dix, Christian Retoré et moi, qui consistait à faire un peu la même chose mais en interprétant les arbres comme des arbres de preuve : on pouvait fabriquer ces agencements à la manière dont on combine des preuves dans certains systèmes logiques (la logique linéaire du second ordre).

La curiosité de Joshi ne s’arrêtait pas à ces questions d’analyse syntaxique : il s’intéressait aussi beaucoup aux liens pouvant exister entre ces schémas formels qu’on retrouve de manière répétée dans les langues et certains autres types de schémas formels, comme les diagrammes de Feynmann, qu’on trouve quant à eux, dans l’exploration des lois physiques. Il croyait voir dans les mécanismes de compensation entre termes négatifs et positifs les mêmes fonctionnements que dans la syntaxe, lorsqu’on fait se correspondre une parenthèse fermante et une parenthèse ouvrante par exemple (opération que l’on fait spontanément chaque fois que l’on fabrique un syntagme).

Conscient que les progrès en linguistique informatique (par exemple en traduction automatique) ne pouvaient venir que du traitement de larges corpus, il avait initié le « Penn Discourse Treebank », immense base de données stockant des analyses syntaxiques faites en TAGs, avec les connecteurs discursifs pouvant les relier. C’est bien sûr ce type de banque de données qui permet aujourd’hui d’avoir des résultats probants en traduction (encore qu’on soit loin du bout du projet, ce qui devrait décevoir tous les apôtres d’une Grande Intelligence Artificielle « destinée à nous supplanter »…).