Pourquoi lire Spinoza aujourd’hui ? Question qui m’apparaît, après avoir écouté mon ami et ex-collègue Philippe Saltel donner un cours destiné au grand public grenoblois dans la bibliothèque du Centre Ville, puis après avoir lu son stimulant petit livre « Spinoza à la plage », qui se veut léger à cause de l’intitulé de la collection (il existe déjà un Einstein à la plage, un Lacan à la plage, un Les Stoïciens à la plage etc.) mais n’en respecte pas moins la profondeur et la complexité d’une pensée. Oui, pourquoi lire Spinoza aujourd’hui, auteur du XVIIème siècle qui apparaît sûrement dépassé à qui a pris connaissance de ce qui lui a succédé dans l’histoire de la philosophie, de Hegel à Heidegger et de Schopenhauer à Freud et Marx.

Pourquoi, si ce n’est pour se renseigner un peu… sur ce qu’on appelle le bonheur.

On peut (et on doit sans doute) passer beaucoup de temps à réfléchir sur le monde, la politique, la vie sociale, l’être humain, la guerre, la chute de l’humanité. Mais on peut aussi prendre un peu de temps pour réfléchir aux conditions du bonheur.

Précisons avant de commencer ce que nous attendons d’une lecture. Non pas seulement qu’elle nous informe de quelque chose de plus ou moins réel, qu’elle nous offre un récit que nous pourrions croire ou ne pas croire : mais qu’elle agisse sur nous, qu’elle transforme en quelque sorte notre état d’esprit du moment. Ainsi la seule lecture nous apporterait cette modification de notre être, et non nécessairement ce qu’elle dit, les arguments qu’elle avance, comme si elle s’adressait à notre intelligence et à notre sensibilité par une sorte de court-circuit direct, un effet d’entraînement, comme des rouages entraînés par une courroie de transmission sans même qu’ils aient pris conscience de ce qui est transmis. Et pourtant ce qui est transmis ici a de l’importance, sert à quelque chose. On gagnerait en lisant le philosophe, de ce fait, sur deux tableaux au moins.

La prouesse de Spinoza, les philosophes le savent, est de partir d’un Etre singulièrement abstrait au sein duquel nous ne serions qu’une modeste partie, il ne part donc pas d’une conscience qui dirait « je », ni d’une divinité qui nous contrôlerait. Si nous sommes une si modeste partie, alors nous ne pouvons pas nous diriger nous-mêmes, nous ne pouvons pas dire « je veux ceci » ou « je veux cela », nous pouvons juste laisser s’exprimer à travers nous notre vraie nature, c’est-à-dire justement cette nature fragmentaire, finie, imparfaite. D’où il vient que nécessairement, nous ne pouvons avoir, au début, que des « idées inadéquates » et que les choses qui nous traversent et nous dirigent sont des affects (Philippe dit que dans les vieilles traductions en français, on disait « sentiments » car on se méfiait du mot « affect », trop germanique paraît-il!). Il est bien sûr des affects positifs (ou bénéfiques) comme il est des affects négatifs (ou nuisibles). Nous éprouvons les premiers comme des manières d’augmenter notre « puissance d’être », et les seconds comme des manières de la réduire. Ce sentiment d’augmentation de notre puissance d’être, voilà ce qu’est la joie. Opposée au sentiment de cette réduction, qui serait la tristesse, d’où cette opposition si souvent évoquée entre passions tristes et passions joyeuses. Si les choses s’en arrêtaient là, nous serions dans le chaos, un vain chaos : de temps en temps triste, de temps en temps joyeux (ce qui est souvent notre sort, il faut bien l’avouer, joyeux quand l’amour nous sourit par exemple et triste quand il ne nous sourit plus). Noter que, souvent, ce qui nous apporte de la joie peut se muer en son contraire, et nous apporter de la tristesse. L’amour encore. Car l’amour éprouvé pour une personne peut devenir souffrance et torture, si cette personne ne vous aime pas, si vous êtes pris par la jalousie etc. Spinoza nous signale perfidement d’ailleurs que l’affect peut d’autant plus nous apporter de joie (c’est-à-dire « d’augmentation de notre puissance d’être ») qu’il est aussi reconnu par d’autres comme légitime dans ce rôle, ce qui, évidemment, ne fait pas l’affaire des amoureux qui veulent bien, un temps, apprécier qu’autrui reconnaisse l’objet de l’amour comme admirable, mais pas trop quand même sans quoi la possessivité qui est une composante de l’amour en prend ombrage ! Et nous voilà pris dans le tourment des passions, nécessairement passives. Alors que la joie, la joie durable, autrement dit le bonheur, ne peut provenir que d’une part active de nous-mêmes.

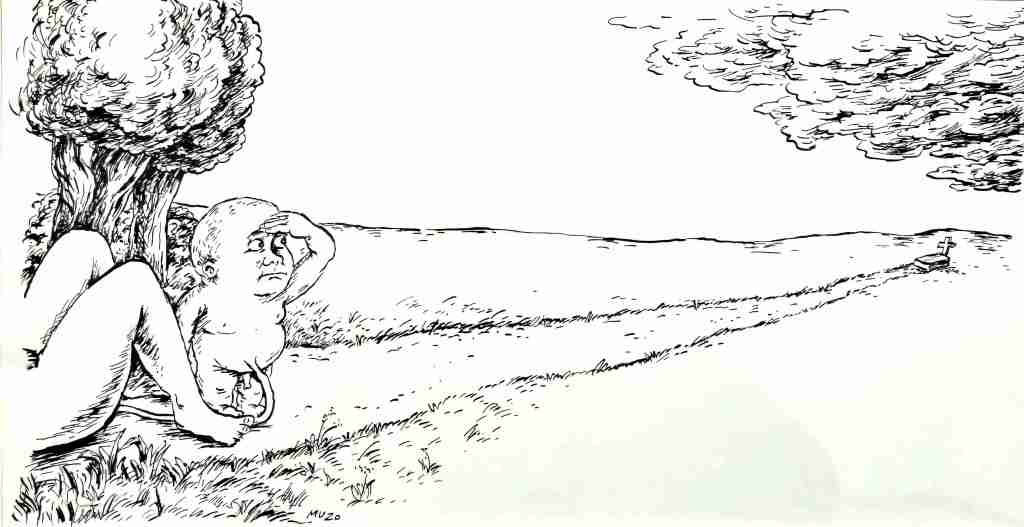

Qu’est-ce qui nous apporte cette part active ? Chez Spinoza, c’est la connaissance bien sûr. Car elle seule nous permet de passer des idées inadéquates à celles qui sont adéquates. Elle a en plus le mérite d’être partageable, contrairement aux objets comme ceux qui provoquent notre amour et qui sont l’objet de passions passives. Ma connaissance et la joie que j’en tire n’enlèvent rien à personne, elles peuvent donc être éprouvées par d’autres sans que moi-même j’en sois affecté. Noter que cette connaissance n’a pas seulement pour siège notre esprit, mais elle parcourt notre corps, ce que nous ressentons par exemple quand nous nous plongeons dans l’eau d’une piscine ou d’une plage et que nous éprouvons la joie de nager : c’est notre corps qui « sait », à ce moment-là, plus que notre esprit (et l’on sait combien sont malheureux ceux qui, croyant avoir appris un exercice physique, par exemple le ski, dans les livres, se trouvent bien dépourvus quand il s’agit de mettre en pratique leur connaissance sur une pente abrupte). Spinoza distingue trois genres de connaissance : le premier se limite à nos connaissances empiriques, par nos sens, le second renvoie à la raison et le troisième est beaucoup plus subtil… il l’appelle l’amour (intellectuel) de Dieu, mais on pourrait tout aussi bien dire l’amour du réel. C’est la connaissance arrivée au point où nous embrassons par le moyen de la raison l’enchaînement des causes qui conduisent à ce que nous sommes, et où nous reconnaissons enfin la Nature en laquelle nous éprouvons notre vraie puissance, et comme cette connaissance nous procure une grande joie et que l’amour n’est rien d’autre qu’une « joie qu’accompagne l’idée d’une cause extérieure », nous éprouvons alors un véritable amour du réel (ou de la Nature, ce que Spinoza appelle Dieu, d’où la notion d’amour intellectuel de Dieu).

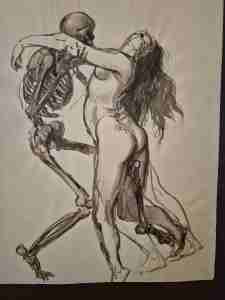

En somme, nous devons passer au cours de notre vie de la situation de notre imperfection en tant que nature fragmentaire au sein de la « grande nature », le plus souvent dirigée par nos idées inadéquates, à une situation d’adéquation totale : nous n’atteignons jamais l’infini, mais si notre Etre s’aligne avec cette pensée de l’infini, alors nous serons dans l’axe du bonheur. C’est du moins ainsi que je comprends Spinoza (ou que je comprends le livre de Philippe Saltel). La connaissance transfère en nous la passion vers l’idée adéquate propre à la raison. C’est là ce qui est fondamental dans notre modeste existence. Comment par exemple s’établit un amour durable après un coup de foudre passionné, comment aussi peut se transmuer notre angoisse fondamentale (par exemple angoisse de la mort) en une reconnaissance résignée de la nécessité. J’entends souvent dire (notamment par des croyants) qu’il nous faut sans cesse nous préparer à notre mort, et pour cela méditer de plus en plus à celle-ci, comme si cette pensée de notre mort allait nous aider au moment d’y passer… Je ne crois pas du tout que ce soit ce que pense Spinoza (non plus que Montaigne d’ailleurs, ainsi que je l’ai entendu dire récemment par une jeune philosophe française). Car le but d’accroître la puissance de notre être n’a pas de raison de s’éteindre de lui-même ; s’il s’éteint, ce sera pour des causes extérieures, maladie, accident, catastrophe. La mort elle-même est la réduction maximum de cette puissance d’être, quand elle approche de zéro, mais avant de connaître ces causes extérieures, notre être demande encore une attention active : il nous faut vivre tant que nous vivons. Nous pouvons même atteindre le sentiment de notre éternité. « Nous sommes éternels » est la maxime spinozienne par excellence, elle est étonnante et nous ne la comprenons pas, en général. (PS : « Nous sommes éternels » est également le titre d’un roman de Pierrette Fleutiaux, pour lequel elle avait reçu le prix Femina en 1990. Quand je lui avais fait part de ma découverte à propos de Spinoza, elle m’avait paru étonnée, elle n’y avait pas pensé, m’avait-elle dit.. et pourtant1). Saltel dit : « il y a une idée de notre corps en Dieu, c’est-à-dire dans la rationalité de la Nature. Il s’agit d’une idée éternelle, comme l’est toute idée de tout corps qui n’est jamais qu’une modalité de l’étendue comme son idée l’est de la pensée ». Je comprends cela à la lumière des derniers développements en physique contemporaine à propos du temps, tels qu’exposés par Carlo Rovelli, « le temps n’existe pas », dit le physicien de manière provocante. Le temps est une perception humaine, liée à ses limitations en tant que partie infime de la Nature, mais si nous pouvions avoir une vision extérieure, embrassant la totalité (telle que seul un Dieu pourrait avoir), alors nous ne verrions qu’un bloc dans l’espace-temps, contenant toutes les vies à la manière de segments ayant un début et une fin, mais chaque segment aurait bien entendu la propriété d’être éternel, c’est-à-dire d’exister hors du temps. Nos idées inadéquates font d’un tel segment une « aventure » dont les extrémités sont dramatisées, mais en prenant conscience, par la vertu de la connaissance, de cette réalité « segmentaire », nous réduisons finalement la crainte que nous avons de la mort.

Les gens qui me lisent parfois seront peut-être étonnés par mon plaidoyer spinoziste, moi qui, d’habitude, passe plus de temps à parler de la critique de la valeur, de Marx, de Moishe Postone ou de Robert Kurz. Je crois pourtant pouvoir établir un lien, notamment entre la Wertkritik et Postone d’un côté et la pensée spinoziste de l’autre. Ce lien est dans la perception de ce qui nous apparaît comme abstraction nous dominant, tant que nous n’avons pas fait l’effort de constituer une vraie connaissance des réalités dont nous n’avons au départ que des idées inadéquates (qu’on peut aussi qualifier de fétiches de la réalité). Postone, par exemple dans Marx, par-delà le marxisme, dit que « la forme de médiation sociale propre au capitalisme génère une nouvelle forme de domination sociale – celle qui soumet les gens à l’impersonnalité, à la rationalisation accrue de contraintes et d’impératifs structurels : la domination des gens par le temps. Loin d’être fantomatique, cette domination est bien réelle. On ne saurait la comprendre adéquatement en termes de domination de classe ou, plus généralement, de domination concrète d’un groupe social ou d’appareils étatique et/ou économiques ». Autrement dit, tant que nous n’avons pas compris ce qui, dans notre environnement social, notre monde « capitaliste », fait que nous sommes asservis à des formes d’être et de rapports de pouvoir, nous restons dominés par ces entités abstraites qui reviennent vers nous alors que c’est nous qui les avons engendrées en partant de nos considérations naïves, nous ne sommes donc pas libres. De même, chez Postone comme chez Kurz, on prendra toutes les distances possibles vis-à-vis de la personnification des rapports de pouvoir pour reconnaître qu’ils sont en eux-mêmes des réalités abstraites et que toute personnification conduit à des formes de fétichisme qui mènent au rejet de l’autre, et notamment à l’anti-sémitisme. Spinoza ne fait pas autre chose quand il cherche à nous éloigner de la haine, en tant qu’affect négatif ne faisant que réduire notre puissance d’agir.

Beaucoup de « marxistes » rejettent la Critique de la Valeur parce qu’elle n’offre pas à leurs yeux de « solution pratique ». Ils restent attachés à la fameuse thèse sur Feuerbach selon laquelle il ne convient plus d’interpréter le monde mais de le transformer, avec la conséquence souvent associée que la théorie ne servirait à rien d’autre qu’à déboucher sur une pratique « révolutionnaire » par laquelle on mettrait à bas le capitalisme. Cette vision, pour Kurz, est naïve et trompeuse, elle a donné lieu à suffisamment de désastres dans l’histoire récente pour qu’on cesse de lui faire crédit, comment espérer provoquer par sa seule volonté un quelconque changement dans l’ordre pratique si l’on n’a pas au préalable analysé et compris ce qui constitue l’essence même du capitalisme. Un lien avec la pensée de Spinoza réside là : c’est dans l’ordre de la connaissance que doit s’opérer d’abord une « révolution » si l’on veut un jour espérer être libre au sens où nous exprimerions notre puissance d’être sans contraintes2.

Trop optimiste, Spinoza ? Sûrement et c’est là ce que lui reprocheront les lecteurs modernes. Il était tentant en son siècle d’affirmer que les affects positifs conduisant à plus de joie et d’amour étaient plus puissants que les affects négatifs et que, en dépit de quelques désordres qui advenaient de ci de là, occasionnés notamment par les effets de foule, l’amour triompherait toujours : n’était-ce pas l’intérêt profond de tous les humains ? Si notre être se tourne naturellement vers ce qui est utile à son accroissement, il va de soi qu’il ne peut se tourner longtemps vers la haine, qui le rapetisse. La vie sociale, chez Spinoza, est un bien car elle a beaucoup plus d’avantages que d’inconvénients, parmi ses avantages la faculté de mettre en commun nos puissances, ce qui les accroît toujours, et donc par un cercle vertueux favorable, cela conduirait à toujours plus de sentiment collectif de solidarité et d’entraide. L’amour, chez Spinoza, se tourne vers des objets (c’est-à-dire aussi des personnes) qui le valent bien et qui renforcent dynamiquement notre désir d’accéder à eux. Car eux-mêmes sont dotés de cette puissance se traduisant par leur persévérance dans l’être. Il n’y a pas de médiation entre les corps et les âmes autre que le soucis d’améliorer nos affects et, si possible, de les faire entrer dans l’ordre de la raison. Tout cela pour dire, bien entendu, que Spinoza n’a pas connu l’expansion du capitalisme, lequel ne devait exister qu’à l’état très embryonnaire en son temps3. Il n’y a pas dans ces pages, de mention de l’argent, ni a fortiori de son fonctionnement (sauf indirectement par le biais de l’avarice, dont on se moque comme chez Molière). Si Spinoza avait pu observer la passion de l’argent qui existe en notre temps, il aurait sans doute été catastrophé, et peut-être aurait-il écrit un autre ouvrage que l’Ethique.

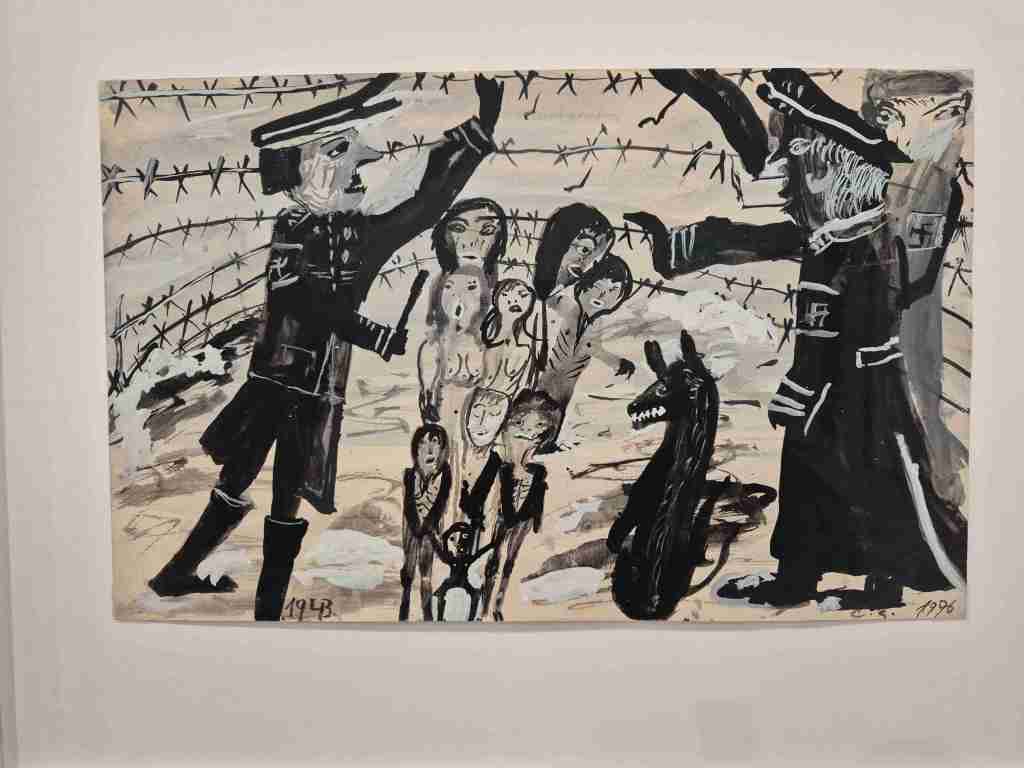

Spinoza ayant pensé que les humains s’attiraient naturellement les uns vers les autres grâce à leur commune envie de faire triompher les passions positives, on ne peut imaginer en en restant à l’Ethique, que les humains se soient rassemblés autour de fétiches et de passions négatives, exprimant leur rage, leur ressentiment et leur colère, qui sont des passions tristes s’il en est, pour engendrer massacres, guerres, émeutes et destruction. Spinoza n’a pas pensé une seconde, semble-t-il, que loin de chercher à étendre leur puissance d’être (ce que Freud appellera plus tard le principe de plaisir), les humains puissent en venir par l’effet de mécanismes abjects dont ils étaient à l’origine mais qui ont formé ensuite les structures qui se sont retournées contre eux et qu’ils ont fétichisées, à, au contraire, développer la négation de l’être, c’est-à-dire des pulsions de destruction et d’auto-destruction.

Il nous reste cependant un livre qui aujourd’hui encore nous donne l’envie d’être conformément à ce qu’il nous inspire et qui nous aide à vivre dans le silence de notre intimité, même s’il ne nous aide pas à comprendre l’enchaînement des causes sociales d’aujourd’hui.

Le petit livre de Philippe Saltel nous en donne un aperçu stimulant. Qui donne une définition du bonheur à toute personne entrant dans l’âge adulte.