On ne peut pas passer tout son temps dans « l’exploration de l’âme », cette recherche qui ne finit jamais, des tourments de l’esprit et du cœur (mais le cœur est esprit, c’est connu), ce « ravissement » qui n’est pas celui de Lol V. Stein mais celui qui est face aux multiples facettes du moi, de l’autre et de leurs infinis modes de relation. Ceci est la spécialité de la littérature et nous en avons vu de belles instances avec le roman de Sarah Chiche et celui de Laurent Mauvignier. Les corps comptent aussi et, au travers d’eux, la matérialité du vivant. La littérature soigne peut-être l’âme (celle-ci ayant un sens complexe et encore à définir) mais la science « répare les vivants » selon les mots de Maylis de Kérangal (qui, pourtant, est une « littéraire »). S’intéresser à la science qui se fait n’est aujourd’hui guère en vogue alors même que notre sort semble en dépendre plus que jamais. On se heurte à des oppositions qui, selon moi, sont artificielles, entre « connaissance » et « savoir », entre « science » et « littérature », entre rigueur et intuition… au terme desquelles les pôles qui se situent plutôt du côté de l’émotion et de la subjectivité l’emportent sur ceux qui sont situés près du réel et de la raison. Et pourtant… c’est bien à la science que nous remettons nos corps dès qu’apparaît en nous un dysfonctionnement, même léger. Qu’est-ce que la science ? On n’en finit pas de répondre à cette question et je ne m’y aventurerai pas, ou du moins pas tout de suite. La science recouvre méthodes et théories, expérimentation et modélisation. Elle n’est pas établie, elle est toujours en train de s’élaborer. Parfois des mirages apparaissent, faisant naître des espoirs fous… j’espère que la récente découverte d’un vaccin contre la Covid, « efficace à 90 % » ne tombe pas dans cette catégorie, lui appartient par contre l’enthousiasme dont furent saisis certains chercheurs lorsque le génome humain fut cartographié et qu’apparurent des possibilités fantastiques d’explorer le réel au moyen du Big Data. C’était extraordinaire, il suffisait de regarder les données et celles-ci allaient parler d’elles-mêmes… Eh bien non.

J’ai pu suivre grâce à Kevin, par Zoom, une conférence passionnante donnée par Giuseppe Longo pour le LIG (Laboratoire d’Informatique de Grenoble), et je remercie abondamment Kevin pour m’avoir permis de profiter de cette opportunité. Le titre en était : Big Data entre science et scientisme. Giuseppe Longo, dont j’ai déjà parlé sur ce blog en faisant notamment référence au rôle qu’il a eu dans la réflexion qui s’est poursuivie aux côtés de Bernard Stiegler, mais aussi à une autre époque, aux côtés de Jean-Yves Girard (dans une approche approfondie de l’origine des lois logiques) commençait par dire à quel point la science contemporaine est redevable aux progrès extraordinaires de l’informatique et des bases de données. Dans de nombreux domaines de la médecine, des avancées incroyables ont été accomplies grâce à cela, notamment en cardiologie. La possibilité d’exploiter des masses de données colossales permet souvent de remettre en cause des idées préconçues. Dans un autre domaine que celui qui était abordé par l’informaticien-biologiste-mathématicien, auquel je pense parce qu’un lien familial m’y conduit, je veux parler de la sismologie, d’immenses progrès ont été accomplis également grâce à cela (mais il est vrai qu’ausculter un corps ou un cerveau ou bien ausculter la Terre sont des activités qui ne sont pas si éloignées l’une de l’autre). Ce succès des bases de données gigantesques (terme par quoi on peut traduire « Big Data ») a entraîné un engouement très fort de la part de spécialistes qui ont pensé qu’il n’était plus nécessaire de produire des théories, faisant ainsi prendre le simple outil pour la totalité de la démarche scientifique. Dès 2008, un certain Chris Anderson, ex-rédacteur en chef de Wired, magazine spécialisé dans les nouvelles technologies (et ami d’Elon Musk) proclamait avec un accent triomphal qu’il n’était plus besoin désormais de théorie puisqu’il suffisait d’examiner les données et que celles-ci « parlaient d’elles-mêmes ». Ce à quoi on pouvait ajouter qu’il est possible aussi d’entraîner un réseau de neurones artificiels pour qu’il détecte des patterns de régularité à l’intérieur d’une masse d’informations, et qu’alors le tour est joué : il n’y a même plus besoin de l’intervention humaine d’un scientifique expert du domaine pour atteindre « la connaissance »… (noter que cette idée est ancienne puisque dès les débuts de l’informatique, il a été fait référence à ce qu’on appelait déjà l’IA (Intelligence Artificielle) et que l’un des plus célèbres spécialistes de l’époque, Herbert Simon, avait conçu un GPS (General Problem Solver) qui, disait-il, simulait parfaitement la démarche du scientifique et pouvait découvrir par lui-même les lois de la nature, il en prenait pour preuve le fait que son système aurait découvert tout seul les lois de Kepler à partir de données qui lui avaient été transmises, c’était gommer le fait que bien entendu, celui qui avait piloté l’expérience avait préparé le travail en aplanissant d’emblée les nombreux obstacles à franchir avant d’arriver aux résultats). Le hic, car il y a un hic, vient de ce que des théorèmes sophistiqués mais déjà anciens qui avaient été prouvés par Ramsey (le traducteur du Tractatus) dans les années 1930, montrent les limites de ces méthodes.

Nous avons souvent été troublés d’apprendre l’existence de corrélations pourtant improbables a priori entre des phénomènes éloignés les uns des autres. Les personnes noyées dans une piscine et les films avec Nicolas Cage (les années où sort un tel film sont celles où le nombre de noyés dans une piscine est le plus grand), le nombre de mariages au Kentucky et celui des personnes décédées à la suite d’une chute d’un bateau de pêche, ou bien l’âge de Miss America et la quantité produite de pommes de terre au Delaware. C’est ce que certains appellent « l’effet cigogne » (car bien sûr… l’arrivée des cigognes est corrélée dans certains villages d’Alsace avec le taux de natalité!). Cela est bien sûr un effet du hasard. Plus même, on peut démontrer que l’observation de ce genre de « spurious correlation » (comment doit-on dire en français ? Corrélation farfelue?) dépend non pas de la nature des données observées mais de la taille de leur ensemble.

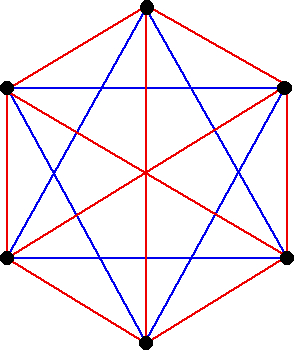

Le théorème de Ramsey, sous sa forme la plus connue, est un théorème de théorie des graphes, il dit ceci :

Pour tout entier c et toute suite d’entiers (n1, n2, … , nc), il existe un entier N tel que pour toute coloration en c couleurs du graphe complet KN d’ordre N, il existe une couleur i et un sous-graphe complet de KN d’ordre ni qui soit monochromatique de couleur i.

Autrement dit, si vous colorez les arêtes d’un graphe complet (c’est-à-dire un graphe où tout couple de sommets est relié par une arête), même si vous avez beaucoup de couleurs à votre disposition, vous allez toujours pouvoir trouver, pourvu que la taille du graphe soit assez grande, un sous-graphe du graphe d’origine, de la taille que vous désirez, qui sera monochrome.

L’algébriste Van der Waerden a démontré à la suite de ce théorème (comme une sorte de corollaire) que pour tous entiers c et k, il existe toujours un entier N tel que toute chaîne faite de c couleurs, de longueur plus grande que N contient une suite avec k occurrences de la même couleur. Imaginons donc ici qu’il y ait deux couleurs correspondant par exemple au nombre de noyés et au nombre de mariages dans le Kentucky, et que nous privilégions une série de nombre de noyés, il va toujours exister, pourvu que N soit assez grand, dans une suite de longueur N, au moins une sous-suite faite d’une série correspondante de nombres de mariages… et, tombant sur une telle sous-suite, nous aurons obtenu l’illusion d’une corrélation significative. La question est bien sûr celle du nombre N, n’est-il pas tout simplement « astronomique » (voire pire, de l’ordre des « Grands Cardinaux », qui sont des nombres inatteignables, et en tout cas excédant tout nombre existant dans notre univers physique) ? Non, dit Longo, s’appuyant sur des travaux qui datent de 2007 (Graham) qui le montrent borné par (2*(k*2)) – où * représente la puissance. Ce n’est donc pas si terrible…

Tout cela pour en venir à quoi ? Eh bien au fait qu’on ne saurait se fier à la seule détection de patterns réguliers dans un grand ensemble de données pour en inférer des lois, et encore moins des structures causales. Les tenants de la « fin des théories » en sont pour leurs frais : il faut encore et encore réfléchir, faire travailler son cerveau afin de poser des hypothèses et formuler des théories plausibles…

Dans la deuxième partie de son exposé, Giuseppe Longo applique ces observations aux recherches sur le cancer, qui constituent désormais l’un de ses principaux axes de recherche (il collabore avec une équipe du MIT sur ce sujet) et il montre l’insanité de tout un courant qui s’est développé à partir des années 2000 et qui a cru que tous les problèmes étaient résolus parce qu’on était arrivé au décryptage du génome. L’idée qui paraissait évidente alors et qui remontait déjà aux années soixante-dix était que tous les cancers dérivaient de mutations géniques dues à des agents extérieurs venus pour « déprogrammer l’ADN » et qu’il allait suffire de trouver de quels gènes il s’agissait pour parvenir à tout résoudre. Mais il est vite apparu que rares sont les cancers dus au simple dysfonctionnement d’un gène. Il y a ainsi, dit Longo, une évidence croissante que la plupart des carcinogènes interfèrent avec l’organisation du tissu, (« Un tissu en biologie est le niveau d’organisation intermédiaire entre la cellule et l’organe. Un tissu est un ensemble de cellules semblables et de même origine, regroupées en amas, réseau ou faisceau (fibre). Un tissu forme un ensemble fonctionnel, c’est-à-dire que ses cellules concourent à une même fonction » – source wikipedia) et non pas en envoyant des signaux chimiques qui « déprogrammeraient l’ADN » (par exemple, il a été montré que l’effet carcinogène de l’amiante n’était pas dû à sa nature chimique intrinsèque, mais au fait qu’elle était présente en micro-fibres « mutilant » le tissu biologique). Ainsi les annonces bravaches des ingénieurs de chez Microsoft qui prétendaient pouvoir allègrement résoudre le problème puisqu’ils se considèrent comme les meilleurs « as » en programmation et en débuggage, deviennent-elles tout simplement ridicules… C’est devant les difficultés ainsi apparues, c’est-à-dire face aux myriades de situations géniques inattendues et de mutations potentielles pouvant affecter les cellules que les chercheurs se sont tournés vers le Big Data et se sont mis, comme dit Longo, à collectionner tous les «-omics » – ou «-omiques » en français : génomique, protéomique, métabolomique…

Jetons les nombres recueillis dans les plus gros clusters de machines jamais constitués et laissons les algorithmes statistiques agir… Seulement voilà, comme montré plus haut, cela ne fonctionne pas, si les données sont assez nombreuses, toutes les corrélations peuvent être trouvées… Sans compter évidemment que lesdits « nombres » ne sont guère interrogés sur leur provenance : avoir une réflexion sur la nature de la mesure (ce que l’on observe) serait déjà introduire la théorie honnie ! Or, sait-on toujours ce que l’on observe, connaît-on la manière dont les mesures sont établies ?

Pour le dire comme Longo, la science sans théorie, sans hypothèses, ça ne marche pas…

Est-ce à dire que tout est perdu et que les recherches sur le cancer sont au point mort ? L’intervenant nous rassure : il existe d’autres approches qui étaient déjà en germe avant que la conception « programmatique » n’enlève le morceau. Une approche, dite TOFT (Tissue Organization Field Theory) est prometteuse : elle prend le problème au niveau de l’interaction entre organisation du tissu et éco-système et repose sur des bases darwiniennes (par exemple, on remettra une cellule cancéreuse dans le bon ordre en la remettant dans un environnement de cellules saines), mais ceci est une autre histoire.

Notons au passage que le nombre de cancers dans le monde est en augmentation constante, ce qui est dû aux 82 000 molécules artificielles mises en circulation, et que si tous les efforts de la recherche médicale ont abouti dans les autres maladies graves (cardio-vasculaires etc.) à une réduction drastique du nombre de morts, dans le cas du cancer, ils ne sont parvenus qu’à maintenir ce nombre constant…

Il est bien sûr fondamental de pouvoir écouter des scientifiques comme Longo, de pouvoir lire leurs articles (qui sont accessibles même aux non-spécialistes) et on se demande pourquoi leurs travaux sont peu mis en évidence. D’une manière générale, cela relève de l’insuffisance de l’effort collectif en faveur d’une culture scientifique. Il est vrai que, comme le dit Pascal Engel à propos de la défense de la raison, il est tellement plus agréable et plus facile de se livrer aux doux plaisirs de la vie (art et poésie) mais ce sont les dures et âpres discussions autour de la science qui font avancer notre savoir, et le savoir est action lorsque cela peut se traduire par le sauvetage de vies humaines. A l’heure du Covid, on devrait particulièrement s’en souvenir.

Nous sommes loin, très loin, des Diafoirus qui prétendent se baser sur l’observation de tout petits échantillons pour apporter la preuve que leurs drogues magiques sont efficaces… (cela serait un comble que l’on prétende que… puisqu’il faut se méfier des phénomènes observés dans les grosses bases de données, il faudrait… ne faire confiance qu’aux petites!).

Et oui… vous prêchez à une convaincue, là.

Vous n’interrogez pas notre… universel (à toutes les époques) désir ? de nous soustraire à la nécessité d’interpréter le monde, au profit d’en avoir une expérience… directe, SANS NECESSITE DE PENSER.

Cette tendance se retrouve à toutes les époques, et fait de grands ravages, que ce soit pour l’interprétation des données scientifiques, l’interprétation des textes sacrés, etc.

Je crois même que Sigmund Freud a construit une théorie dessus où il introduit le concept de « pulsion de mort » qui pour moi, est plutôt une pulsion pour détruire la (sa…) pensée pour pouvoir devenir un automate (mais.. un automate LIBRE, bien entendu…).

Hier, au téléphone je parlais à une amie dont le mari est un scientifique d’un certain âge. Lui, et moi, il y a quelques années, nous avions déjà remarqué qu’il y avait une forme de laxisme ? relâchement de la rigueur méthodologique, qui s’introduisait dans même les journaux scientifiques de haut niveau. Laxisme, en tout cas, par rapport à l’époque où il était pleinement actif.

Je continue à rappeler qu’il y avait une époque où on parlait de l’art médical, et non pas de science.

Cela me semble… préférable, d’autant plus que le propre de l’approche scientifique est de privilégier une EXACTITUDE qui ne colle pas bien, de mon point de vu, avec notre condition de fragiles vivants.

La médecine ne peut pas, et ne doit pas, être une science exacte, au prix de nous faire nous conformer à sa.. PULSION d’exactitude.

Et puis, le parti pris qui voudrait assigner à résidence la vérité du côté de la science, et son approche du monde me semble de plus en plus.. artificiel ? A dépasser maintenant.

Il est diablement difficile de penser ? l’intrication esprit/corps/coeur, sans opérer des séparations artificielles qui nuisent à notre nécessaire et salutaire.. incarnation.

J’aimeJ’aime